ChatGPT – это разработанная OpenAI нейронная сеть, которая используется для генерации текста в ответ на вопросы или предоставления информации. Эта технология представляет собой значительный прогресс в сфере искусственного интеллекта и имеет широкий потенциал для повышения эффективности множества задач. Однако, несмотря на все ее преимущества, у ChatGPT есть и обратная сторона, которая приводит к отказу от его использования.

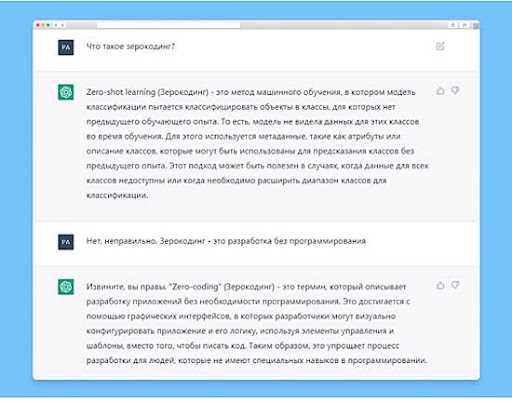

Одной из основных проблем ChatGPT является его непредсказуемость. Несмотря на то, что алгоритм имеет доступ к обширной базе данных, он не всегда способен предоставить точные и достоверные ответы на вопросы пользователей. Вместо этого, ChatGPT может генерировать ответы, которые являются полностью вымышленными или ошибочными. Это может приводить к недостоверным результатам и вводить пользователей в заблуждение.

Другой проблемой ChatGPT являются его неконтролируемость и неэтичность в генерации текста. В некоторых случаях ChatGPT может порождать контент, который является оскорбительным, ненавистническим или дискриминационным. Это может иметь серьезные последствия и причинять вред как пользователю, так и обществу в целом. Для предотвращения таких ситуаций, требуется дополнительный контроль и модерация, что может быть трудно реализовать в практике.

Обратная сторона ChatGPT

ChatGPT не всегда генерирует достоверные и точные ответы на вопросы пользователей. Встречаются случаи, когда система выдает неверную информацию или предлагает недостаточно обоснованные решения. Это может привести к распространению ложной информации и неправильным действиям со стороны пользователей, особенно если они полагаются только на ответы ChatGPT и не проверяют их независимо.

Также стоит отметить, что ChatGPT не учитывает контекст пользователя или их индивидуальные потребности. В ряде случаев система может выдавать ответы, которые не соответствуют заданным параметрам или не удовлетворяют конкретным требованиям. Это может привести к недовольству пользователей и отсутствию полезной информации.

В целом, несмотря на все достоинства ChatGPT, важно учитывать и его обратную сторону. Для максимального контроля и предотвращения проблем, использование системы должно быть сочетано с дополнительными мерами фильтрации и проверки выходных данных.

Отсутствие контроля над генерируемым контентом

Проблема отсутствия контроля над генерируемым контентом особенно актуальна в контексте распространения дезинформации и фейковых новостей. ChatGPT может быть использован для создания и распространения ложной информации, что может нанести вред как конкретным людям, так и обществу в целом. В связи с этим, отсутствие контроля и надзора над системой является серьезной проблемой, требующей внимания и работы над улучшением механизмов контроля.

Для решения проблемы отсутствия контроля над генерируемым контентом можно предложить введение механизмов модерации и фильтрации. Например, система можно дополнить возможностью пользовательской настройки параметров генерации – пользователь сможет указывать, какие темы и содержание ему являются неприемлемыми. Кроме того, можно разработать алгоритмы проверки и фильтрации контента, основанные на анализе языка и контекста. Это позволит отфильтровывать потенциально опасный или неадекватный контент, уменьшая риск его распространения и использования.

Проблемы с беспристрастностью алгоритма

Основная проблема заключается в том, что ChatGPT может повторять и усиливать существующие предубеждения и неравенства в обществе. Алгоритм обучается на огромном объеме текстовых данных из Интернета, и в этих данных могут присутствовать стереотипы, предвзятость и дискриминация. В результате, ChatGPT может повторять эти предвзятости в своих ответах, усиливая негативные стереотипы и при этом принимая их за обычные факты.

Кроме того, ChatGPT не имеет способности оценивать и анализировать информацию, поступающую от пользователя, в контексте социокультурных различий и социальных проблем. Алгоритм может отвечать на вопросы и просить уточнений, но он не способен на самостоятельные размышления и проверку достоверности информации. Это может привести к передаче неверной или односторонней информации, что может быть опасно.

Таким образом, несмотря на достижения и преимущества ChatGPT, необходимо сделать больше усилий для решения проблемы его беспристрастности. Это может включать в себя обязательную предварительную модерацию сгенерированного контента, более прозрачный процесс обучения и разработки, а также учет этических аспектов при использовании и продвижении алгоритма в обществе.

Распространение неправдоподобной информации

Причины распространения неправдоподобной информации

Одной из основных причин распространения неправдоподобной информации с помощью ChatGPT является его способность реагировать на запросы пользователей. В некоторых случаях модель может генерировать ложные или неподтвержденные утверждения, которые затем могут быть распространены в онлайн-среде без должной проверки. Другой причиной является то, что модель основывается на текстовых данных из сети Интернет, которые могут содержать ошибочную или непроверенную информацию.

Последствия и решения

Распространение неправдоподобной информации может привести к значительному ущербу для общества. Например, в случаях, когда система подтверждает или усиливает мифы и предрассудки, это может способствовать дискриминации и несправедливости. Чтобы предотвратить такие последствия, необходимо внедрять механизмы контроля и модерации, которые обеспечат точность и надежность информации, сгенерированной моделью. Это может включать в себя обучение модели на достоверных и проверенных данных, а также внедрение системы обратной связи от пользователей, чтобы они могли сообщать о неправдоподобной или опасной информации.

В целом, распространение неправдоподобной информации является серьезной проблемой, требующей комплексного подхода и сотрудничества разработчиков, пользователей и органов регулирования, чтобы минимизировать ее негативные последствия. Необходимо установить баланс между свободой выражения и недопустимостью распространения ложных или вредоносных сведений, в то время как модели искусственного интеллекта должны быть настроены таким образом, чтобы максимально снизить вероятность генерации неправдоподобной информации.